I denne artikel kan du læse mere om:

Hvad er en robots.txt fil?

Hvad siger Google om en Robots.txt fil?

Hvad skal der stå i en robots.txt fil?

Samt et par tools, der kan gøre det lettere og sjovere at lave en robots.txt fil

Indledning – skal læses

Når du skal i gang med at lave din robots.txt fil, så er der rigtigt mange ting, der kan gå galt. Der tages derfor absolut forbehold og enhver form for ansvar frasiges. Ansvaret er helt og aldeles dit, hvis der går noget galt, hvis du laver en robots.txt fil.

Hvad er en robots.txt fil?

Forestil dig, at du er Google. Du skal finde ud af, hvad der står på alle sider på nettet – i verden. I 2021 var der indekseret 6 milliarder sider, hvilket svarede til cirka 50% af alle sider. Selvom du arbejder i døgndrift, har du lidt småtravlt.

For at hjælpe dig har du opfordret alle hjemmesider til at lave en vejviser eller en oversigt over de sider, der ikke skal indekseres. Dermed bliver dit arbejde markant lettere, da du ved, at en række CMS autoproducerer en masse url’er, der ikke giver brugerne eller Google (dig) værdi.

Med andre ord så er en robots.txt fil en oversigt, over de url’er der enten skal udelades eller indbefattes i indekseringen.

Hvordan crawler Google internettet?

Google crawler internettet ved at bruge bots. Der er i skrevne stund 17 forskellige bots. Du kan finde listen her.

Disse bots følger enten en adresse, som er udpeget fra Google Data Warehouse, eller også følger den links til at finde nyt indhold. Det betyder, at hvis der ikke bliver linket til en given url, så kan det godt være rigtigt svært for Google at finde url’en.

Google inddeler selv indekseringsprocessen i tre stadier:

- Crawling: Google aflæser hjemmesider (tekst, billeder, video og CSS) med bots

- Indeksering: De forskellige bots vender tilbage til Data Warehouse til opbevaring og analyse

- Visning af resultater: På baggrund af crawling og indeksering vises de bedste resultater til en given søgning.

Hvad siger Google om Robots.txt filer?

Først og fremmest siger Google, at en side ikke nødvendigvis behøver en robots.txt fil. Det samme er gældende for X-Robots tags, som ligeledes instruerer Bots med eksempel rel=”nofollow” i head delen. (Du kan læse indlægget om x-robots tagget her)

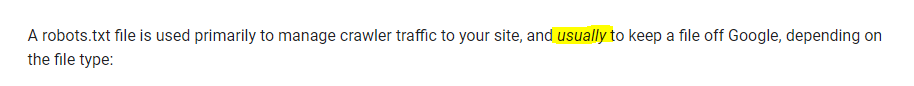

Samtidig skriver Google i sin dokumentation, at en robots.txt fil normalt viser Google, hvad der ikke skal indekseres – NORMALT:

Med andre ord bliver robots.txt filen mere en anvisning end en regel med tekniske specifikationer. Google bestemmer selv, hvad der skal indekseres. Især hvis der bliver linket til en url, som er disallowet i robots.txt, så vil url’en komme i indeks.

Det er desuden ikke sikkert, at alle bots aflæser en url på samme måde, så de får det samme resultat. Der kan være forskel på Googles egne bots og bots fra andre søgemaskiner.

Du kan læse Googles retningslinjer omkring robots.txt her.

Hvad skal der stå i en robots.txt fil?

User agent

sitemap

allow

disallow

Google anbefaler, at filtyper af .css, .js og billedfiler ALDRIG skal udelades fra en robots.txt fil. Ellers kan Google ikke afgøre, hvilket indhold der er på en given url.

Tools, der kan gøre det lettere og sjovere

http://www.glassgiant.com/ascii/

Brug dette tool til at lave ASCII images

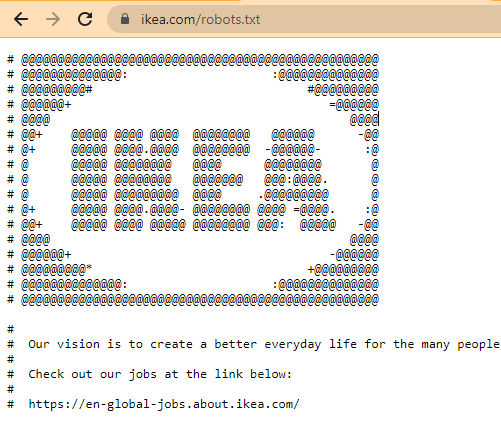

Nå ja – tjek lige IKEAs robots.txt fil: